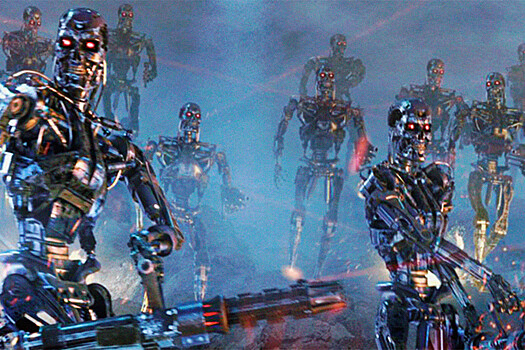

Международная группа ученых из Германии и Великобритании изучила, могут ли модели на основе искусственного интеллекта (ИИ) выйти из повиновения людей и создать угрозу для человечества. Исследование опубликовано на сайте Ассоциации компьютерной лингвистики (ACL).

Специалисты сосредоточились на так называемых эмерджентных способностях — навыках, которые развиваются у ИИ независимо, а не преднамеренно кодируются в программе создателями нейросети.

Команда провела эксперименты с четырьмя различными ИИ-моделями, давая им задачи, которые ранее были определены как эмерджентные. Ученые хотели выяснить, способен ли искусственный интеллект создавать новые способы выполнить поручения, или же они просто сложным образом действуют в рамках своего кода.

Для всех четырех моделей способность следовать инструкциям, запоминание и лингвистическая компетентность смогли объяснить все показанные способности. Ученые не нашли никаких признаков независимого поведения у рассмотренных нейросетей.

«Существовали опасения, что по мере того, как модели будут становиться все больше и больше, они смогут решать новые проблемы, которые мы сегодня не можем предсказать. Это создает угрозу того, что эти более крупные модели могут приобрести опасные способности, включая рассуждение и планирование.

Наше исследование показывает, что страх того, что модель выйдет из-под контроля и сделает что-то совершенно неожиданное, инновационное и потенциально опасное, необоснован», — отметила соавтор работы Тайяр Мадабуши.

Ученые добавили, что сегодня модели искусственного интеллекта не обладают интеллектом как таковым. Однако это не значит, что они полностью безобидны и не представляют угрозы людям.