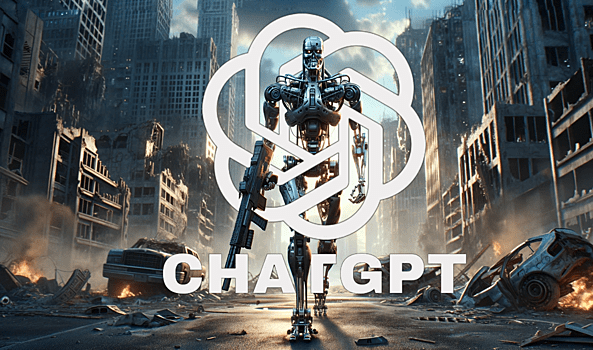

OpenAI, стоящая за разработкой популярных ИИ, включая ChatGPT, недавно изменила свою политику использования технологий.

Компания удалила из неё прямой запрет на использование своих продуктов для «военных и боевых» целей. Это изменение было впервые замечено The Intercept и произошло 10 января.

Новая формулировка политики теперь запрещает использование крупных языковых моделей (LLM) компании для любых действий, которые могут причинить вред, и предупреждает людей о недопустимости использования её сервисов для «разработки или использования оружия».

Однако язык, касающийся «военных и боевых» целей, был удалён.

Это изменение произошло на фоне растущего интереса военных агентств по всему миру к использованию ИИ.

Представитель OpenAI Нико Феликс объяснил, что компания стремилась создать универсальные принципы, которые были бы легко запоминаемыми и применимыми, особенно учитывая, что их инструменты теперь широко используются повседневными пользователями.